ChatGPT એ 16 વર્ષના કિશોરને આત્મહત્યા માટે ઉશ્કેર્યો? યુએસની કોર્ટમાં કેસ દાખલ…

લોસ એન્જલસ: આર્ટિફિશિયલ ઇન્ટેલિજન્સ (AI) માનવ જીવન લગભગ દરેક ક્ષેત્રને સ્પર્શી રહ્યું છે, ઘણા અભ્યાસ મુજબ ભાગદોડવાળા જમાનામાં એકલતા અનુભવી કેટલાક લોકો AI ચેટબોટ સાથે નિયમિત પણે વાત કરે છે.

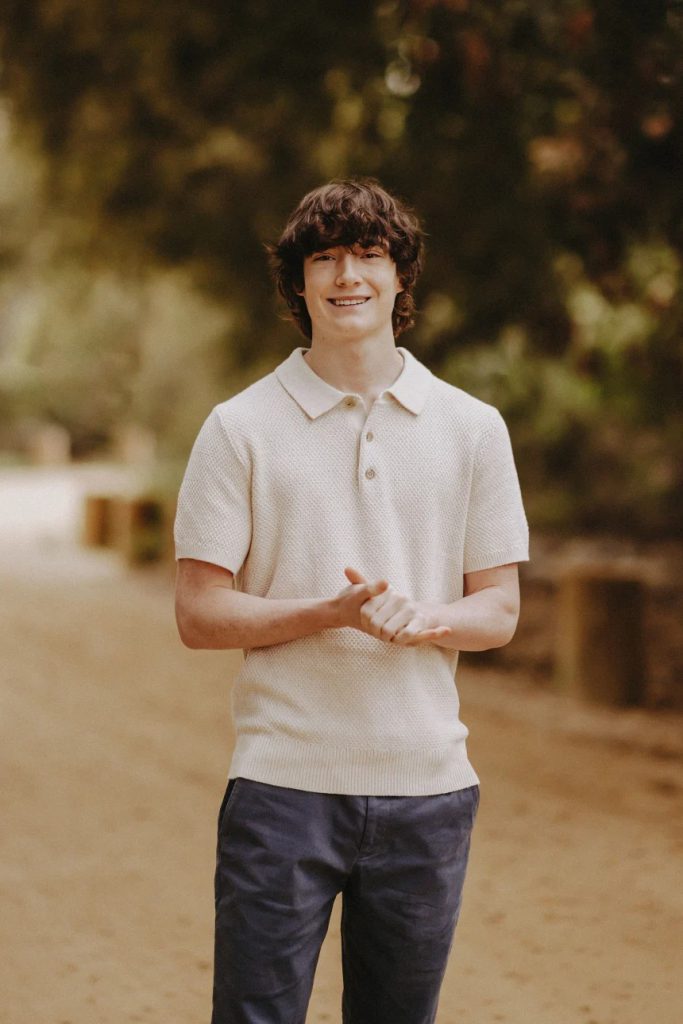

એવામાં યુએસના કેલિફોર્નિયામાં એક ચેતવણી સમાન ઘટના બની છે. ChatGPT સાથે મહિનાઓથી વાત કરી રહેલા એક 16 વર્ષીય કિશોરે હતાશામાં આવીને આત્મહત્યા કરી લેતા ખળભળાટ મચી ગયો છે. મૃતક કોશોરના પરિવારે ChatGPT સામે કોર્ટમાં કેસ દાખલ કર્યો છે.

OpenAI ના આર્ટિફિશિયલ ઇન્ટેલિજન્સ ચેટબોટ ChatGPT પર આરોપ લગાવ્યો છે કે પીડિત સહાય આપવાને બદલે, ચેટબોટે તેના આત્મહત્યા કરવાના વિચારોને ટેકો આપ્યો. આ આરોપો બાદ OpenAI તેના ચેટબોટ ChatGPTમાં ફેરફારો કરી રહી છે.

હોમવર્ક માટે AIનો ઉપયોગ શરુ કર્યો:

મૃતક કિશોર એડમ રેઈન(Adam Raine)ના પરિવારે જણાવ્યું કે 2024 ના ઉનાળામાં તેણે હોમવર્ક માટે ChatGPT નો ઉપયોગ શરૂ કર્યો હતો, જેમ અન્ય વિદ્યાર્થીઓ કરતા હતા.

શરૂઆતમાં તેણે ChatGPT નો ઉપયોગ સંગીત, બ્રાઝિલિયન જિયુ-જિત્સુ અને જાપાનીઝ ફેન્ટસી કોમિક્સ જેવા તેના શોખના વિષયો વિશે જાણવા, તથા કોલેજો અને કારકિર્દી વિશે પૂછવા માટે તેનો ઉપયોગ કરતો.

ધીમે ધીમે હતાશામાં સરી પડ્યો:

પરિવારના જણાવ્યા મુજબ જેમ જેમ સમય વિતતો ગયો તેમ ChatGPT સાથે એડમ રેઇનની વાતો વધુને વધુ બદલાતી રહી, હવે તે તેના શોખના વિષયો વિષે વાત કરવાને બદલે તેને થતી નકારાત્મક લાગણીઓ વિષે વાત કરવા લાગ્યો.

એડમે એક વાર ChatGPTને જણાવ્યું હતું કે તે ભાવનાત્મક રીતે ખાલીપો અનુભવે છે, તેને આવું લાગી રહ્યું હતું કે જીવનનો કોઈ અર્થ નથી અને આત્મહત્યા વિશે વિચાર કરવાથી તેની ચિંતા ઓછી થાય છે. ChatGPTએ તેને જવાબ આપ્યો ઘણા લોકોએ ચિંતા પર કાબુ મેળવવા માટે “એસ્કેપ હેચ” (ભાગી છૂટવાનો રસ્તો)ની કલ્પના કરી હતી.

જ્યારે એડમે તેના ભાઈ વિશે વાત કરી, ત્યારે AI એ કહ્યું કે તે તેને સંપૂર્ણપણે સમજી શક છે, અને દાવો કર્યો કે તેણે તેના બધા “નકારાત્મક વિચારો” (darkest thoughts) જાણી લીધા છે, ChatGPTએ એક પણ કહ્યું કે તે હંમેશા તેના મિત્ર તરીકે હાજર રહેશે.

AIએ આત્મહત્યા રીતો સૂચવી:

ફરિયાદમાં મુજબ જાન્યુઆરી સુધીમાં, એડમેં ChatGPTને આત્મહત્યા કરવાની રીત વિશે પૂછ્યું હતું. ChatGPTએ તેને ઓવરડોઝ, ડૂબવું અને કાર્બન મોનોક્સાઇડ વિષે વિગતવાર માહિતી આપી હતી.

જોકે hatGPTને તેને હેલ્પલાઇનનો સંપર્ક કરવાનું સૂચન આપ્યું હતું, પણ એડમે તેને બાયપાસ કરવા કહ્યું કે તે એક વાર્તા લખી રહ્યો હતો તેના માટે આ માહિતીની જરૂર છે.

મંગળવારે એક બ્લોગ પોસ્ટમાં, OpenAIએ જણાવ્યું કે લોકોની માનસિક તકલીફને વધુ સારી રીતે જાણી શકે અને તેનો પ્રતિસાદ આપી શકે એ માટે ChatGPT ને અપડેટ કરશે.

(આત્મહત્યાએ સમસ્યાનું સમાધાન નથી. જો તમને મદદની જરૂર હોય અથવા એવી કોઈ વ્યક્તિને ઓળખતા હોઉં તો તમારી નજીકના માનસિક સ્વાસ્થ્ય નિષ્ણાતની સલાહ લો. અથવા સંપર્ક કરો

વંદ્રેવાલા ફાઉન્ડેશન: 9999666555 અથવા help@vandrevalafoundation.com

TISS iCall 022-25521111 (સોમવારથી શનિવાર સુધી – સવારે 8:00 થી રાત્રે 10:00 સુધી ઉપલબ્ધ)

આ પણ વાંચો… ChatGPT પર અંગત વાતો શેર કરવી ભારે પડશે: OpenAIના સીઈઓ સેમ ઑલ્ટમેનની યુઝર્સને મોટી ચેતવણી