રશ્મિકાના આપત્તિજનક વીડિયોએ મચાવ્યો હોબાળો, શું હોય છે Deepfake ટેકનોલોજી જેનાથી નકલી વીડિયો પણ લાગે છે અસલી

રશ્મિકા મંદાનાનો Deepfake વીડિયો હાલમાં ઇન્ટરનેટ પર ખૂબ જ વાઇરલ થઇ રહ્યો છે. આ વીડિયોમાં જે યુવતી દેખાઇ રહી છે તે ખરેખર રશ્મિકા નથી, તે અન્ય કોઇ યુવતી છે જેના ચહેરા પર રશ્મિકાનો ચહેરો લગાવી ફેક વીડિયો ક્રિએટ કરવામાં આવ્યો. આ એક ખતરનાક ટેકનોલોજી છે જેમાં વીડિયોમાં દેખાતું વ્યક્તિ પોતે જ છે કે અન્ય કોઇ તે સાબિત કરવું ખૂબ જ અઘરું પડે છે.

કોઇપણ ટેકનોલોજી જ્યારે શોધાય છે ત્યારે તેનો હેતુ કાર્યોને સરળ બનાવવાનો અને માનવીય શ્રમ ઓછો કરવાનો હોય છે, પરંતુ આ જ ટેકનોલોજીનો જ્યારે દુરૂપયોગ થવા લાગે ત્યારે ક્યારેક તેના માઠા પરિણામો પણ ભોગવવા પડે છે. Deepfake ટેકનોલોજી નવી નથી, છેલ્લા ઘણા વર્ષોમાં સાયબર ક્રિમિનલ્સ તેનો બહોળો ઉપયોગ કરી રહ્યા છે. આર્ટિફિશિયલ ઇન્ટેલિજન્સનો જ્યારથી ઉપયોગ વધ્યો છે ત્યારથી આ ટેકનોલોજી વાપરીને અનેક સાયબર ક્રિમિનલ્સ લોકોને બ્લેકમેલ કરતા હોવાના કિસ્સા વધ્યા છે. જેને પગલે અનેક લોકોએ Deepfake સામે લડવાની એક સિસ્ટમ ઉભી કરવાની માગ કરી છે. જો કે તેનું AI મિકેનીઝ્મ જટિલ હોવાથી સંપૂર્ણપણે ટેકનોલોજીથી છુટકારો મેળવવો મુશ્કેલ છે.

Deepfake ટર્મ Deep Learning પરથી આવ્યો છે જે machine learning નો એક ભાગ છે. આમાં મલ્ટીપલ લેયર્સ હોય છે જે આર્ટિફિશીયલ ન્યૂરલ નેટવર્ક પર બેઝ્ડ હોય છે. તેના એલ્ગોરિધમમાં ફેક ડેટાને અસલી ડેટામાં પરિવર્તિત કરવામાં આવે છે.

Deepfake ટેકનોલોજીની અનેક એપ્સ પ્લેસ્ટોર પર ઉપલબ્ધ છે જેના પર તાત્કાલિક પ્રતિબંધ મુકાવો જોઇએ. આ એપ્સ વડે ફોટો-વીડિયોમાં વ્યક્તિના હાવભાવ બદલવા, એક વ્યક્તિનો ચહેરો હટાવીને અન્યનો લગાવી દેવો, શારીરિક આકાર બદલવો, વ્યક્તિનો અવાજ સુદ્ધાં બદલી શકાય છે. નવાઇની વાત એ છે કે લગભગ દરેક એવી વ્યક્તિ કે જે ફોટો-વીડિયો એડિટીંગને લગતા અલગ અલગ એપ્સ તથા ટુલ્સ વાપરતી હશે તે સીધી કે આડકતરી રીતે Deepfake ટેકનોલોજીનો જ ઉપયોગ કરી રહી છે.

તમે અનેક વીડિયો જોયા હશે જેમાં પીએમ મોદીનો ફોટો વાપરીને તેમના અવાજમાં ગીતો ચાલતા હોય, ડોનાલ્ડ ટ્રમ્પ અને ઓબામા એકસાથે ડાન્સ કરી રહ્યા છે, પોપ ફ્રાન્સિસ સ્ટાઇલીશ જેકેટમાં દેખાય છે. આ બધુ Deepfake ટેકનોલોજીનો ઉપયોગ કરીને બનાવાય છે. પહેલી નજરમાં આ બધા વીડિયો અસલી જ લાગે છે, તેમને ધ્યાનથી જોયા બાદ સમજાય છે કે વીડિયો બનાવટી છે.

Encoder અને decoder વડે પહેલા જેનો બનાવટી વીડિયો બનાવવાનો હોય તે વ્યક્તિના ઓરીજીનલ ફોટો વીડિયો લઇ તૈયાર કરવામાં આવેલા ટુલ્સમાં નાખવામાં આવે છે. AI આ ફોટો અને વીડિયોને એનાલાઇઝ કરે છે. આર્ટિફિશિયલ ઇન્ટેલિજન્સના અનેક ટુલ્સમાં અલગ અલગ પ્રકારની સુવિધાઓ હોય છે. જેના વડે કોઇપણ લીડર-સેલેબ્રિટીની તસવીરો, વીડિયો, તેમની સ્પીચ સાથે છેડછાડ કરીને અસલી લાગે તેવા વીડિયો બનાવી શકાય છે. Encoder વડે જે-તે ફોટો કોમ્પ્રેસ થઇ જાય છે, તે ડેટાનું સ્વરૂપ ઘટાડી દે છે. Decoderનું કામ હોય છે તેને ફરીથી ઓરિજીનલ સ્વરૂપમાં લાવવાનું. ઓટોએન્કોડરમાં કંપ્રેશન-ડિકંપ્રેશન સિવાય નવી ઇમેજ તૈયાર કરવી, આંખની-આઇબ્રો મુવમેન્ટ જેવી ઝીણી ઝીણી બાબતો બદલી શકાય છે. આવા અઢળક સોફ્ટવેર તથા એપ્સ માર્કેટમાં ઉપલબ્ધ છે.

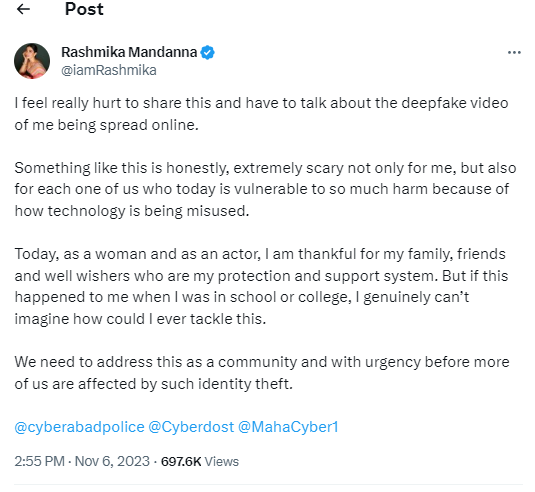

અભિનેત્રી રશ્મિકા મંદાનાએ તેના આ વીડિયો પર પ્રતિક્રિયા આપતા સોશિયલ મીડિયા સાઇટ X પર પોસ્ટ મુકી હતી, તેણે લખ્યું હતું કે ટેકનોલોજીનો દુરૂપયોગ થઇ રહ્યો છે. તેને પોતાનો આ વીડિયો જોઇને ડર લાગી રહ્યો છે. “આવું કંઈક થવું એ અત્યંત ડરામણું છે, માત્ર મારા માટે જ નહીં, આજે ટેક્નોલોજીનો જે રીતે દુરુપયોગ થઈ રહ્યો છે તેના કારણે દરેક વ્યક્તિને નુકસાન થઇ શકે છે.” રશ્મિકાએ જણાવ્યું હતું.